我观察到一个很有意思的行业趋势:农货电商的竞争,正在从上半场的“流量之争”,悄悄转向下半场的“供应链效率之争”。过去,大家比的是谁的嗓门大,谁能获取更多用户。但现在,随着流量红利见顶,真正的壁垒变成了谁能把一斤蔬菜、一箱水果,以更低的损耗、更快的速度、更准的需求,送到消费者手里。说白了,这是一场关于效率和成本的硬仗。而打赢这场仗的核心武器,不再是营销预算,而是大数据技术。如何利用数据做好农货电商的供应链优化,已经成为决定一个平台能否活下去、活得好的关键。

一、为什么说数据分析是农货电商的“新基建”?

很多人的误区在于,以为农货电商就是把农产品搬到网上卖。但实际上,这只是完成了“交易”环节,真正复杂且决定生死的,是“交付”环节。我经常说,传统电商卖的是标准工业品,而农货电商卖的是“生命”。它有保质期,易损耗,需求波动大,这些都是天然的痛点。换个角度看,如果只是简单地开个网店,你其实只是在用昨天的销售数据“看后视镜开车”,对于明天市场需要多少西红柿、后天哪个区域的土豆会畅销,几乎是两眼一摸黑。这种模式下,滞销和损耗是必然的。这就是为什么我们需要将数据分析视为“新基建”。

说到这个,数据分析在农货电商领域扮演的角色,远不止是做个销售报表那么简单。更深一层看,它是连接生产端、流通端和消费端的“神经网络”。通过大数据技术,一个优秀的农货电商解决方案能够整合销售数据、天气数据、物流数据、甚至市场舆论数据,进行精准的需求预测。比如,系统预测到下周某城市会降温,对火锅类蔬菜的需求可能会上涨25%,平台就可以提前与产地协同,增加备货,并优化冷链路线,确保在需求爆发时既能满足供应,又不会因为盲目备货而造成浪费。这背后,从数据清洗到模型训练,再到最终形成决策建议,每一步都是在为农业供应链优化添砖加瓦。

---

【误区警示】

一个普遍的误解是:“我只要买一套昂贵的系统,就能实现数据化运营了。” 但事实是,系统只是工具,思维的转变才是关键。很多企业上了系统,却还是沿用老思路,只看GMV(商品交易总额)这类结果指标,而忽略了过程中的效率指标,比如库存周转率、订单履约成本、商品损耗率等。没有数据分析的思维,再好的系统也只是一堆昂贵的代码。真正的农货电商数据分析,是把业务的每一个环节都变成可以量化和优化的指标。

二、如何选择真正能优化供应链的农货电商平台?

既然数据如此重要,那么下一个问题就是,市面上这么多农货电商解决方案,到底该如何选择?一个常见的痛点是,很多平台在宣传时都说自己是“大数据驱动”,但实际交付的功能却千差万别。作为决策者,你不能只听故事,要看它在“技术实现”层面到底能做什么。在我看来,一个真正能优化供应链的平台,至少要在三个层次上表现出色:数据的“收”、 “洗” 和 “用”。

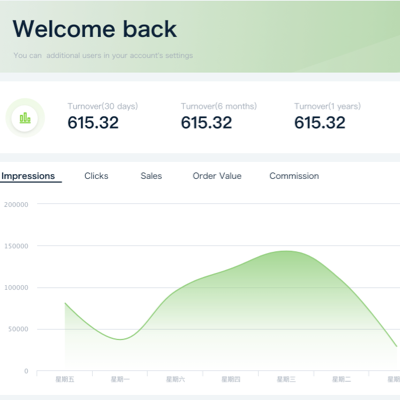

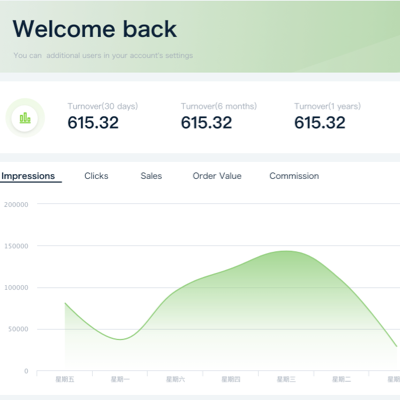

首先是“收”,也就是数据采集的广度。只采集订单数据的平台,能力是极其有限的。一个优秀的系统,必须能打通多个数据孤岛,不仅包括销售数据,还应该能接入仓储WMS、物流TMS、产地ERP,甚至是外部的天气、节假日等数据源。数据的维度越丰富,分析和预测的准确性就越高。其次是“洗”,即数据清洗和处理能力。农业数据天然就是“脏”的,存在格式不一、信息缺失等问题。如果平台没有强大的数据清洗能力,那么分析结果就是“垃圾进,垃圾出”,毫无意义。最后是“用”,也就是数据的应用能力,这直接体现在可视化看板和指标拆解上。一个好的可视化看板不是一堆图表的堆砌,而是能让管理者一眼看出问题所在,并且支持层层下钻,找到问题根源。比如,当你发现本月损耗率上升了3%,系统应该能让你轻松地拆解出,是哪个品类、哪个仓库、哪个环节出了问题。

为了更直观地说明,我们可以看一个简单的对比:

| 功能维度 | 基础型平台 (行业基准) | 高级数据驱动平台 (推荐标准) |

|---|

| 数据处理能力 | 仅支持手动导出报表 | 自动化数据清洗与ETL处理 |

| 分析核心 | 回顾式销售统计 | 预测式需求分析与损耗预警 |

| 可视化看板 | 固定的静态图表 | 可交互、支持指标拆解的动态看板 |

| 供应链协同 | 信息孤岛,依赖人工沟通 | 数据驱动上下游自动协同 |

三、农货电商数据化转型中,最容易踩的坑是什么?

即便选对了平台,数据化转型之路也并非一帆风顺。根据我的观察,企业在实践中还是会遇到各种农货电商常见误区。最大的一个坑,就是“重技术、轻业务”。很多公司花大价钱引入了大数据技术,搭建了炫酷的可视化大屏,但业务人员根本看不懂,也不知道怎么用这些数据来指导日常工作。最后,数据系统成了摆设,业务决策还是靠经验、拍脑袋。这本质上是技术和业务的脱节。

不仅如此,对“数据质量”的忽视是另一个致命伤。前面我们提到了数据清洗的重要性,但在实际操作中,这往往是最被低估的环节。企业急于求成,希望马上看到分析结果,却不愿意投入时间和资源去梳理和治理源头数据。要知道,一个错误的邮编、一个不规范的商品命名,都可能导致整个分析模型的偏差。可以说,数据清洗的工作量,有时甚至占到整个数据分析项目的60%以上,其重要性不言而喻。如果你的供应商告诉你,他们的数据方案可以“即插即用”,无需关注数据治理,那你可要多留个心眼了。

---

【案例分享】

我们来看一个正面的例子。华南地区一家名为“果速达”的独角兽企业,在创业初期同样饱受高损耗率的困扰。他们引入一套侧重于农业供应链优化的农货电商解决方案后,并没有急于做复杂的预测模型,而是先花了三个月时间,专注做“指标拆解”和“数据治理”。他们把“订单准时履约率”这个大指标,拆解为“仓库分拣时长”、“干线运输时长”、“末端配送时长”等数十个子指标,并为每个环节建立数据采集和清洗标准。通过可视化看板,运营团队每天都能清晰地看到是哪个环节拖了后腿,并进行针对性优化。仅仅半年,他们的综合损耗率就从行业平均的22%降到了12%以下,这为他们后来的快速扩张奠定了坚实的成本优势。

本文编辑:帆帆,来自Jiasou TideFlow AI SEO 创作

版权声明:本文内容由网络用户投稿,版权归原作者所有,本站不拥有其著作权,亦不承担相应法律责任。如果您发现本站中有涉嫌抄袭或描述失实的内容,请联系我们jiasou666@gmail.com 处理,核实后本网站将在24小时内删除侵权内容。